A Tesla começou a pedir a autorização de usuários do beta do sistema de direção autônoma Full Self-Driving (FSD) para que as câmeras internas e externas dos carros possam registrar vídeos em casos de riscos de segurança ou acidentes, atrelando as gravações a motoristas e carros específicos.

Anteriormente, a empresa já usava vídeos para o sistema de aprendizado de máquina, necessário no aprimoramento do software e das suas ferramentas, mas eles eram anônimos.

“Ao habilitar o FSD Beta, eu forneço permissão para a coleta de imagens associadas ao Número de Identificação do Veículo pelas câmeras externas e da cabine, caso aconteça um risco sério ou um evento de segurança, como uma colisão”, informam os termos de serviço da nova versão beta (10.5).

Segundo o portal Electrek, a mudança pode significar que a Tesla procura garantir evidências durante casos em que o FSD é acusado de ser o responsável pelo acidente.

Assistente, não autônomo

Vale ressaltar que a Administração Nacional de Segurança de Tráfego Rodoviário dos EUA (NHTSA, em inglês), a agência reguladora da padronização de veículos automotores no país, abriu uma investigação em agosto sobre o piloto automático. Além disso, a instituição também está analisando uma denúncia envolvendo o FSD e a colisão de um Model Y no começo de novembro. Segundo o relato do motorista, o software forçou o carro na contramão e impossibilitou a tomada de controle pela vítima.

Atualmente, a Tesla está disponibilizando a nova versão de testes a indivíduos com uma Pontuação de Segurança acima de 98 — métrica da empresa para avaliar o comportamento de motoristas no dia a dia. Além de ser um piloto exemplar, é necessário adquirir o atrelado a uma mensalidade de US$ 199, cerca de R$ 1,1 mil, ou por um pagamento único de US$ 10 mil (R$ 55,9 mil).

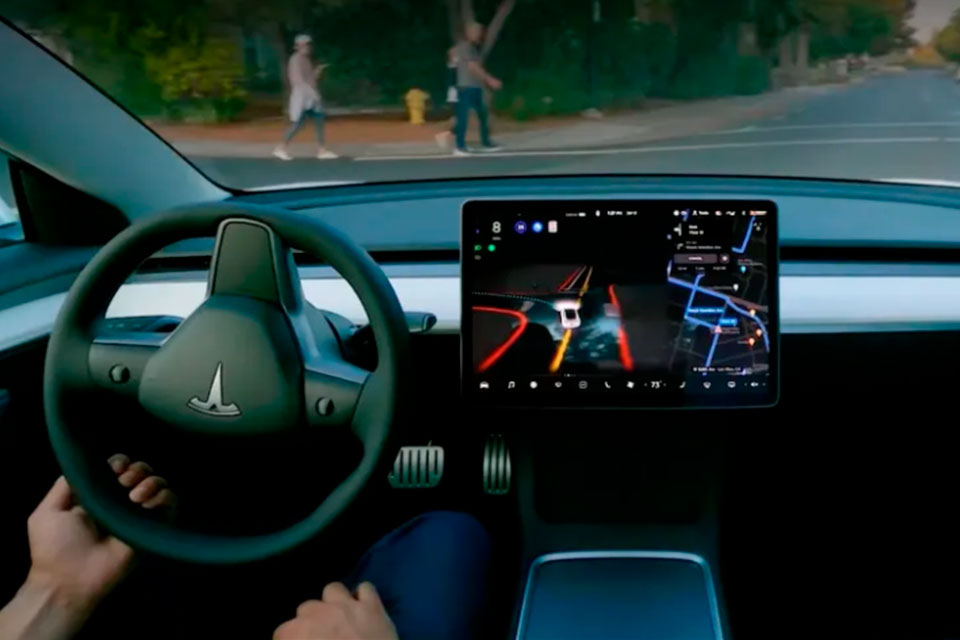

Apesar do nome, o FSD ainda é considerado um sistema de assistência ao motorista de nível 2, sendo capaz de controlar a direção, frenagem e aceleração dentro de circunstâncias específicas, mas exigindo a atenção proprietário.

Source link